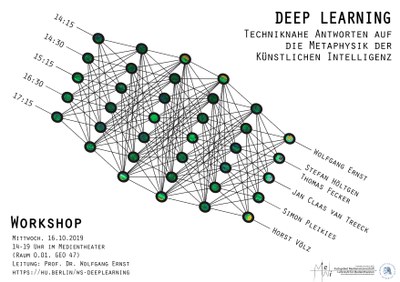

Deep Learning

Techniknahe Antworten auf die Metaphysik der Künstlichen Intelligenz - Ein Workshop

Angesichts der Hardwarevergessenheit in der aktuellen Diskussionen um künstliche Intelligenz, und der damit einhergehenden Ästhetik einer letztendlichen "Humanisierung" der Maschine, stehen eine kritische "Erdung" dieses Diskurses von Seiten der techniknahen Medienwissenschaft, sowie deren Antwort auf gewisse Mythologeme der KI, an.

In diesem Sinne stellt sich das Lehrgebiet Medientheorien in Form seines Auftaktworkshops zum Wintersemester 2019/20 den Studierenden und Assoziierten der hiesigen Medienwissenschaft vor. Das Zusammenkommen im Medientheater der Humboldt-Universität beteiligt sich an den aktuellen Diskussionen über KI und Machine Learning durch eine dezidiert medienepistemologische Pointierung und technologische Grundierung des Diskurses im Sinne "radikaler" Medienarchäologie sowie verwandter Herangehensweisen.

- Kurzlink zu dieser Seite: http://hu.berlin/ws-deeplearning

- Kurzlink zur Plakatgrafik: http://hu.berlin/ws-deeplearning-poster

Zeit: Mittwoch, 16.10.2019, 14-18 Uhr

Ort: Medientheater (Georgenstraße 47, Raum 0.01)

Tagungsablauf

Vorträge

Prof. Dr. Wolfgang Ernst: Wo finden künstliche Intelligenz und das "Deep" Machine Learning wirklich statt? – Eröffnungsthesen

Die Hardwarevergessenheit in der aktuellen Diskussionen um künstliche Intelligenz und Machine Learning, und die damit einhergehenden Ästhetik einer letztendlichen "Humanisierung" der Maschine, stellen eine Herausforderung an das Selbstverständnis techniknaher Medienwissenschaft dar. Sie antwortet darauf durch eine kritische "Erdung" gewisser Mythologeme der KI, durch eine dezidiert medienepistemologische Pointierung und technologische Grundierung des Diskurses. Damit stellt sich die medienarchäologische Gretchenfrage nach dem Verhältnis symbolischer Operationen, wie sie die mächtige mathematische Modellierung neuronaler Netze durch Matrizen und Vektorfelder darstellen, zu den materiellen Kontingenzen ihres tatsächlichen Technológos. Aber was heißt es, in Zeiten von Künstlicher Intelligenz "medias in res" zu gehen: Gilt immer noch der kybernetische Primat der "Black Box"? Handelt es sich beim "Deep" Machine Learning um eine Eskalation kybernetischen Denkens oder um eine neue Qualität? Emergiert hier ein neuer Medienbegriff oder lässt er sich noch in die Sprache der universellen Turingmaschine zurückübersetzen - eine Sprache, die nach wie vor in Begriffen der Informatik erlernt werden kann und soll?

Dr. Stefan Höltgen/Thomas Fecker: Künstliche Dummheit. Stationen der maschinellen Akkommodation an die natürliche Intelligenz

Computerspiele gehören zu den ältesten Anwendungen Künstlicher Intelligenz und haben bereits zur Frühzeit des Digitalcomputers als Modelle für künftige (Einsatz-)Möglichkeiten und Grenzen der Rechentechnik gedient. Die Implementierung künstlich-intelligenter Kontrahenten hat dabei zwei Strategien verfolgt: KIs zu generieren, die Spiele so gut wie möglich beherrschen und solche, die sich dem menschlichen Gegenspieler gegenüber so fair wie möglich (aber auch nur so fair wie nötig) verhalten. Für beide Strategien kamen unterschiedliche Technologien zum Einsatz, die von der Ebene der Elektronik übe die Logik bis hin zur Algorithmik aus spieltheoretische Elemente in Computer implementierten. Im Vortrag soll zunächst die (Technik-)Geschichte der KI etappenweise an spezifischen Spielstationen theoreitsch nachvollzogen werden, bevor im Anschluss die Implementierung eines künstlichen "Pong"-Gegenspielers (geboren aus den Videosignalen des Spiels) in seinem mikrozeitlichen Verhalten vorgestellt wird.

Dr. Jan Claas van Treeck: Deep Learning, Architektur, Infrastuktur

Abseits von Fragen nach dem eventuellen Status von künstlicher Intelligenz und ihrer Metaphorik, finden AI- und Deep-Learning-Anwendungen längst annähernd ubiquitäre und gewinnbringende Anwendungen in Witschaft und Industrie. In den gewinnorientierten Fokus von Anwendern rücken dementsprechend mehr und mehr Fragen der Infrastruktur und der Ökonomie der AI, auf die mit neuen Hardware-Entwicklungen geantwortet wird, die eben nicht das Wesen der computerisierten Berechnung ändern, sondern durch strukturelle Modifikationen vor allem Probleme der Infrastuktur und Ökonomie adressieren. AI und Deep Learning zeigen sich so vor allem als Phänomene, deren Operation zwar banal scheint, die in ihrer infrastrukturelln Inter-Operation jedoch jene eskalatorischen Kräfte gewinnen, die sich anschicken zu technologischen conditio sine qua non zu werden, wenn sie es nicht schon sind. Am Beispiel der Nutzung von Grafikkarten als AI-Hardware und neueren Chiparchitekturen wie Fujitsus DLU wird versucht die infrastrukturellen Verschaltung, eben Inter-Operationen freizulegen.

Simon Pleikies B.A.: Deep Learning als Black Box? Der Wunsch nach idealer Determinierbarkeit

Auch wenn die Funktionsweise von Deep Learning grundsätzlich bekannt ist, so sind einzelne Ergebnisse für Menschen teils schwer nachvollziehbar. In der gesellschaftlichen Auseinandersetzung mit konkreten Entwicklungen und theoretischen Möglichkeiten künstlicher Intelligenz wird Deep Learning daher häufig mit einer Black Box verglichen. Dieser Begriff steht im Zusammenhang mit Deep Learning ebenso für überzogene Hoffnungen wie auch Ängste. Somit manifestieren sich an ihm Fragen um Machtverhältnisse gleichermaßen wie Fragen nach dem Wesen des Menschlichen. Für eine kritische Begriffsarbeit werden in dem Vortrag zwei Perspektiven gegenübergestellt: Die Beschreibung von Deep-Learning-Verfahren als Suche nach zunehmend komplexeren Repräsentation des Inputs und eine radikal-konstruktivistische Verwendung des Begriffs ›Black Box‹, nach der uns objektive, beobachterunabhängige Aussagen über die Welt prinzipiell verwehrt bleiben.

Prof. Dr. Horst Völz: Einfluss der Grenzen der Speicherung auf die KI

Es gibt acht Etappen der Speicherung. Sie verlaufen nach dem Gesetz des ressourcenbegrenzten Wachstums. Der Übergang zwischen den Etappen erfolgt nach der 85%-Regel. Mit jedem Übergang entstehen Vorteile, aber auch Probleme. In der jetzigen siebenten Etappe – technische Speicherung – streben wir der absoluten Grenze der Speicherung zu. Ihre Vorteile sind bereits relativ gut erkennbar. Doch über die möglichen Nachteile ist zu diskutieren. Sie könnten völlig neue Konsequenzen für den Menschen und auch für die KI bedeuten. Es gibt bereits umfangreiche Hinweise auf einen sinkenden IQ. Sie werden diskutiert und mögliche Folgen für die KI abgeleitet.

Referenten

Wolfgang Ernst ist seit 2003 Ordentlicher Professor für Medientheorien an der Humboldt Universität zu Berlin. Er war nach seiner Promotion zunächst Forschungsstipendiat am Deutschen Historischen Institut in Rom, dann am Forschungsschwerpunkt Literatur in Berlin, und von 1995-1999 wissenschaftlicher Mitarbeiter für "Theorie und Archäologie der Medien im Kunstkontext" an der Kunsthochschule für Medien in Köln. Es folgten Gastprofessuren im Fach Medien an der Bauhaus-Universität Weimar, an der Ruhr-Universität Bochum, sowie an der Universität Paderborn. Aktuelle Forschungsschwerpunkte: Radikale Medienarchäologie als Methode techniknaher Medienanalyse; Speichertheorie; kulturelle Übertragungstechniken; Ästhetik und Theorie der zeitbasierten und -kritischen, besonders der sonischen Medien. Deutschsprachige Monographien u. a.: Das Gesetz des Gedächtnisses. Medien und Archive am Ende (des 20. Jahrhunderts), Berlin 2007; ferner die komplementären Bände: Chronopoetik. Zeitweisen und Zeitgaben technischer Medien; Gleichursprünglichkeit. Zeitwesen und Zeitgegebenheit technischer Medien (Berlin 2012); Signale aus der Vergangenheit. Eine kleine Geschichtskritik (München 2013); Im Medium erklingt die Zeit. Technologische Tempor(e)alitäten und das Sonische als ihre privilegierte Erkenntnisform (Berlin 2015)

Stefan Höltgen studierte zwischen 1996 und 2000 Germanistik, Philosophie, Soziologie und Medienwissenschaften an der Friedrich-Schiller-Universität Jena. 2009 promovierte er mit einer Dissertation über "Medien- und Gewaltdiskurse im authentischen Serienmörderfilm" an der Rheinischen Friedrich-Wilhelms-Universität in Bonn. Seit 2008 lebt und arbeitet er in Berlin als freier Journalist und Publizist sowie seit 2011 als Wissenschaftlicher Mitarbeiter am Lehrstuhl für Medientheorien des Fachgebiets Medienwissenschaft der Humboldt-Universität. Dort kuratiert er die technischen Sammlungen des Medienarchäologischen Fundus und des Signallabors und betreibt ein Forschungsprojekt zur Archäologie der frühen Mikrocomputer und ihrer Programmierung, das zugleich Dissertationsprojekt am Lehrstuhl für Informatik und Gesellschaft der HU Berlin ist. 2016/2017 war er Vertretungsprofessor für "Medien, Algorithmen und Gesellschaft" am Institut für Medienwissenschaften der Universität Paderborn. 2019 hat er einen Lehraufenthalt an der Greenwich University (London). Neben der Veröffentlichung von Monografien und Sammelbänden ist er regelmäßig Autor von Film- und Computerspiel-Kritiken, Rezensionen und Artikeln mit den Schwerpunkten Computer, Medien, Kultur und Technik (sowie deren Geschichte und Wissenschaften) in Sammelbänden, Online-Magazinen und Zeitschriften. Seit 2015 ist er Mitherausgeber der Reihe Computerarchäologie und Redakteur der Zeitschrift Grundlagenstudien aus Kybernetik und Geisteswissenschaft (GRKG). Seit 2014 organisiert er das Vintage Computing Festival Berlin. Seit 2012 veranstaltet er den regelmäßigen Workshop "Game Circuits - Operative Computerspielanalyse".

Jan Claas van Treeck, PhD ist seit 2014 wissenschaftlicher Mitarbeiter des Lehrstuhls für Medientheorien an der Humboldt-Universität zu Berlin und Honorardozent an den Fresenius Hochschule Berlin. Er studierte Germanistik, Medienwissenschaft und Theaterwissenschaft an der Ruhr-Universität Bochum und der Yale University und arbeitete lange Jahre als Consultant und Freelance-Projektmanager für Global Fortune 500-Unternehmen. Aktuelle Forschunsschwerpunkte: Operativität/Performativität, Mensch-Maschine-Interaktionen, Posthumanismus, Cyborgismus und Biohacking.

Simon Pleikies studierte Medienwissenschaft, Philosophie und Internationale Literaturen an der Eberhard Karls Universität in Tübingen und erhielt dort vielfältige Einblicke in Forschung, Lehre und v.a. in die Medienpraxis. Er produzierte Radio-Sendungen des europäischen Radionetzwerks Micro-Europa, entwickelte Audioguides und erarbeitete mit Studierenden ein Interview-Buch zur Konstruktion von Medienimages und der Sucht nach Aufmerksamkeit unter Leitung von Prof. Bernhard Pörksen und Wolfgang Krischke (»Die Casting-Gesellschaft«, Köln 2010). Daneben arbeitet er seit 2012 als Webentwickler sowie im Korrektorat und sammelte Erfahrungen mit automatisierter Texterstellung. Seinen B.A. absolvierte er 2017 mit einer praktischen Arbeit über die Kulturtechnik des Vorlesens. Seit 2018 studiert er Medienwissenschaft (M.A.) in Berlin.

Horst Völz ist 1930 in Bad Polzin geboren. 1952 erwarb den Abschluss als Rundfunkmechaniker. 1954 schloss er sein Studium an als Diplom-Physiker an der Universität Greifswald mit einer Arbeit über RC-Generatoren ab. 1958 promovierte er über die Theorie der Frequenzmodulation bei der Videospeicherung Von 1959 bis 1989 war er an der Akademie der Wissenschaften der DDR zu Berlin tätig. Ab 1961 war er Leiter der Arbeitgruppe Magnetische Signalspeicher AMS und blieb bis zur Auflösung 1989 für sie immer trotz anderer Aufgaben ihr wissenschaftlicher Leiter. Sie war international als wissenschaftliche Einrichtung für die Speichertechnik hoch anerkannt. Neben vielen anderen entwickelt sie das aufgedampfte Metalldünnschichtband und für Russland die wissenschaftlichen Kosmospeicher Typ R1. Etwa 70 Geräte waren erfolgreich und ohne Ausfall im kosmischen Einsatz. Der letzte Speicher R3m ist der größte jemals gebaute Magnetbandspeicher mit internationalem Einsatz für die Erkundung des Marsmondes Phobos. Von 1962 bis 1988 hatte er an der HU Berlin den Lehrauftrag für „Elektronik für Physiker“. 1964 habilitierte er an HU Berlin mit einer Erweiterung der Informationstheorie. 1967 wurde er zum Direktor des Institutes für Optik und Spektroskopie berufen. 1969 war er Gründungsdirektor des Zentralinstituts für Kybernetik und Informationsprozesse (ZKI). Von 1992 bis 1995 war er nach der Wende an der Freien Universität Berlin tätig. Er hielt auch Lehrveranstaltungen an der TU Berlin und der privaten Filmhochschule Babelberg. Auch im Ruhstand hielt und hält er immer noch regelmäßig Vorlesungen, vor allem zur Informationstheorie und Speicherung.